Un video puede ser falso, pero el daño, real. Cada vez más adolescentes son víctimas de deepfakes: imágenes o videos generados con inteligencia artificial que reproducen sus rostros en escenas sexuales no consentidas.

La inteligencia artificial está al alcance de todos y cada vez con más facilidad. Aunque se trata de una tecnología que simplifica múltiples tareas, también ha abierto una puerta peligrosa: su uso para cometer ciberdelitos. Entre ellos, los deepfakes, videos, imágenes o audios manipulados digitalmente para imitar la apariencia o la voz de una persona. Se convirtieron en una de las expresiones más alarmantes.

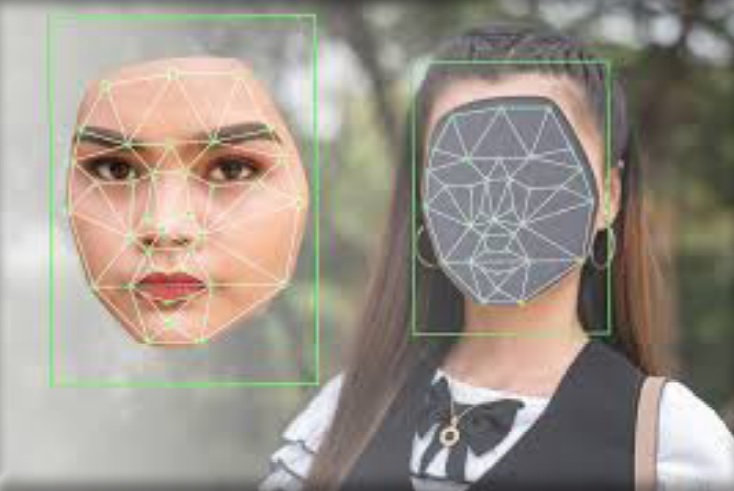

Los deepfakes utilizan inteligencia artificial para superponer rostros, clonar voces o alterar movimientos faciales, haciendo parecer que alguien dice o hace algo que nunca ocurrió. Si bien comenzaron como una forma de entretenimiento o experimentación tecnológica, hoy se emplean para suplantar identidades, difundir discursos falsos y producir material sexual no consentido, afectando tanto a personas como a empresas.

Entre los tipos más frecuentes se encuentran:

- Clonación de voz: la IA puede replicar una voz humana con solo unos segundos de grabación.

- Sincronización de labios: el movimiento de la boca en un video real se modifica para coincidir con un audio falso.

- Intercambio de rostros:los algoritmos permiten colocar la cara de una persona sobre otra, incluso en tiempo real durante videollamadas.

UN FENÓMENO QUE CRECE

Según Europol, las imágenes sexuales de menores creadas con inteligencia artificial aumentaron un 360% en el último año. En España, un caso en la región de Extremadura expuso la magnitud del problema: más de veinte familias denunciaron que sus hijas habían sido víctimas de deepfakes pornográficos generados por compañeros.

En Argentina, se registraron situaciones similares en escuelas de Córdoba, Chaco, Río Negro y la provincia de Buenos Aires, donde adolescentes denunciaron la creación y circulación de imágenes falsas con sus rostros.

En Santiago del Estero, un fotógrafo de 23 años fue investigado por aprovechar su trabajo para acercarse a menores y luego compartirles material sexual manipulado, donde incluía también a amigos de su principal víctima.

Estos episodios reflejan una nueva forma de violencia digital que atraviesa generaciones y deja expuesta la vulnerabilidad de niños, niñas y adolescentes frente al uso malicioso de la IA.

EL VACÍO LEGAL EN LA ARGENTINA

El Código Penal argentino, en su artículo 128, sanciona la tenencia, distribución y producción de material de abuso sexual infantil. Sin embargo, no contempla las imágenes generadas por inteligencia artificial, ya que no representan abusos “reales”. Esto deja a las víctimas en un limbo jurídico donde las únicas herramientas posibles son las demandas civiles por daños y perjuicios.

La Ley Olimpia, recientemente incorporada a la Ley 26.485 de Protección Integral a las Mujeres, reconoce la violencia digital como una forma de violencia de género, permitiendo intervenir en estos casos cuando las víctimas son mujeres o adolescentes. Pero cuando los afectados son varones, la justicia solo puede actuar a través de medidas cautelares civiles para solicitar la eliminación del contenido y proteger el interés superior de los menores.

QUÉ HACER ANTE UNA IMAGEN VIRAL SIN CONSENTIMIENTO

La Red Colaborativa de Inteligencia, un espacio interinstitucional conformado por especialistas, universidades y organismos públicos, publicó el informe “Proteger identidades digitales”, que brinda herramientas para enfrentar el problema. Entre sus recomendaciones se encuentran:

- Pedir a las plataformas la eliminación inmediata del contenido.

- Solicitar el “desentrenamiento” de la IA que utilizó esos datos (machine unlearning).

- Denunciar ante las autoridades.

El documento insiste en que el consentimiento digital, especialmente en menores de edad, no puede ser asumido ni forzado. Según la ley argentina, los menores de 13 años no pueden autorizar el uso de su imagen; entre los 13 y 16 necesitan supervisión, y desde los 16 el consentimiento debe ser informado y seguro.

Los deepfakes ponen a prueba los límites del derecho y la ética. En un contexto donde la tecnología evoluciona más rápido que la legislación, la prevención, la educación digital y la creación de marcos legales específicos son pasos fundamentales para proteger a quienes hoy crecen en entornos hiperconectados.

Fuentes: Deepfakes y adolescentes: existe un vacío legal sobre los videos con contenido sexual creados con IA y su difusión en redes-Chequeado

Deepfakes e infancias: una guía para no mirar para otro lado-Revista Quorum

Más Leídas